一、机器学习、理论物理、计算社会学的碰撞 | 谢泽柯

谢泽柯 东京大学工学系研究科硕士二年级

研究方向:机器学习的物理方法。用物理的模型和方法来探究机器学习的理论机制。

2017年之夏,古北水镇,天朗气清,惠风和畅。集智俱乐部和凯风基金会顺利举办了第二届集智凯风研读营。继去年“几何与学习”的主题后,本次研读营又让机器学习、理论物理、计算社会学三者擦出了火花。集智凯风研读营绝不同于一般的读书会——这里碰撞的是前沿的科学进展,是跨学科的科技创想。当然,这一切的基础是那群齐聚一堂、求知论道的青年才俊。

要问笔者最喜闻乐见的是谁?那当然是敬(meng)爱(meng)的理论物理大神尤亦庄了(星星眼)!笔者私下有一个用热力学理论改进机器学习算法的想法,却被一个问题困惑多日——机器学习训练集和热力学温度之间的关系。很明显的一点是,当我们把热力学温度的概念引入机器学习,机器学习系统的温度就是由训练集决定的。训练集越大,模型的热涨落越小,即温度越低。E大(指哈佛大学博士后尤亦庄)用3分钟教会我如何证明机器学习中的训练集大小和温度的准确表达式。

当然,不只是只有笔者私下喜欢尤亦庄。“谈笑有鸿儒,往来无白丁”,这话说集智研读营大概是一点不差的。我们这里还有着更多蕴含洞见的头脑,更多唇枪舌剑的激荡。

1

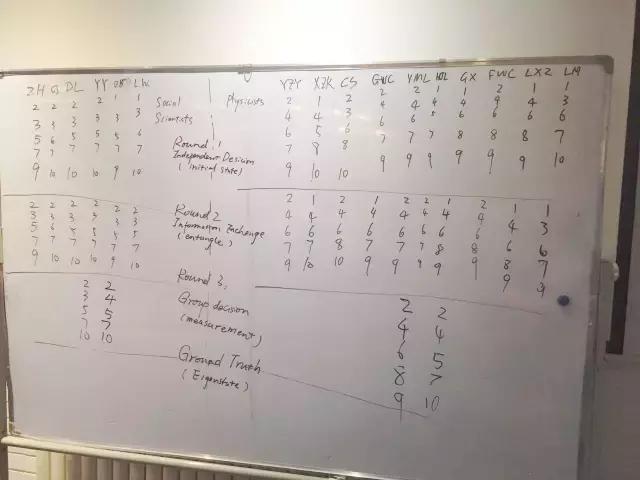

社会学游戏

第一日下午,从计算社会学的几位朋友领头设计了一个研读营所有人参与的社会学游戏。全部人员按照背景分为两组,分别为物理组和社会学组。物理组提出5个topic,每个topic下附上一优一劣两篇paper。社会学方面也是提出5个topic,每个topic下同样附上一优一劣两篇paper。那么某个领域的学者能否独立在阅读标题和摘要后判断另一个领域论文的优劣呢?在互相讨论后,大家又能否判断地更准确?学者会因为其他认可某项研究而变得更认可该研究吗?

从更大的方面来讲,文化产品的流行起来的过程是否有很大的随机成分呢?研讨会上一位来自普林斯顿的在读博士生张涵介绍了一个经典社会学实验得到的有趣结论,文化产品的流行大体上和产品质量是正相关的,但消费者极容易被其他用户的倾向影响。最流行的文化产品会受总销量、总下载量、总收藏量等因素影响而拉开与其他产品popularity的差距。原来一次跨领域读文献游戏背后也可以有这么多社会学背景的。

2

从物理到智能

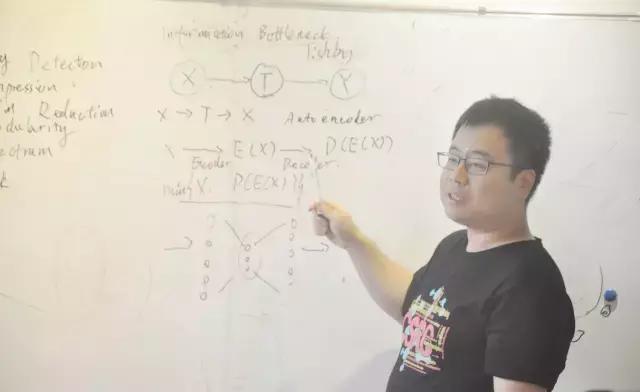

而笔者最投入的一场讨论是关于“物理与智能”的。我们从自然科学的诸多角度审视了深度学习。

从数学的角度来看,深度神经网络是一种具有极好表达能力的模型。只要有足够多的神经元,我们能拟合任何连续的目标函数。而当神经元数目接近的时候,深的网络比宽的网络具有更好的表达能力。尽管深度网络的强大表达能力有着严密的数学基础,但是神经网络的泛化能力却是很令人吃惊的。从统计学习的角度,一般认为至少10个以上的样本才足够较好估计一个模型参数。而深度模型的参数往往是远远多于样本数。这样“粗略”估计得到的模型参数为什么还能在测试集上有良好的表现呢?神经网络谜一样的泛化能力是深度学习理论的一大挑战。

从物理的角度来看,物理定律在机器学习中有非常巧妙的体现。由于真实世界的数据始终是符合物理定律的这个世界的某种描述,这些符合物理定律的数据注定只是整个数学空间的一小部分。比如说,100*100的灰度图,数学空间里有256的1000次方种图片,但是物理世界会出现的图片(比如数字、猫),实际上是非常有限的。所以一种可能的解释是,神经网络和真实世界都符合某种统计先验。这种先验的存在让神经网络学到的函数相当程度上贴近符合物理现实的函数。除此之外,物理学中的空间平移对称性、时间平移对称性也是重要的先验。其在机器学习中的体现就是卷积神经网络和LSTM模型。卷积神经网络底层共享了探测图像特征的kernel,这里利用的物理先验是空间平移不变性(平移10个像素的猫还是一只猫)。LSTM则共享了时间序列的模式,利用的物理先验则是时间平移不变性(语言序列始终遵循特定的语法结构)。

为什么神经网络很可能天然地符合物理先验呢?

我们再进一步从生物学的角度来看这个问题。我们知道,神经网络模型与大脑实际的神经网络结构类似,都具备类似于layer的层级结构。在漫长的进化过程中,为了更好地感知物理世界,人脑进化出的层级的神经网络。这件事本身就说明了,层级的神经网络很可能是适于学习这个物理世界的,是符合物理先验的。机器学习科学家发现卷积核非常适于学习图像中的底层特征,其生物学上的对应就是视觉神经细胞的感受器非常接近于卷积核。

大概只有在这样的研读营,在这样的跨领域交流的气氛下,你才能同时发现这么多领域的有趣灵魂,这么多角度的深刻思想。

复杂网络,机器学习与全息原理 | 甘文聪

甘文聪 南昌大学硕士二年级

研究方向:量子信息与量子引力的交叉。 曾做过张量网络在AdS/CFT中演生引力的方案;全息复杂度与量子保真率对偶的研究;以及deep learning的双曲几何与全息的关系研究。

这是我第一次参加集智研读营,被这里的氛围所吸引。这里集合了计算社会学,计算机科学,理论物理学,生物物理学等等各个方向的学者。在我们来到的第一天晚上就展开了激烈的讨论。Kevin的社会学实验,尤亦庄的限制玻尔兹曼机与统计物理和全息引力,苑明理的机器学习与微分方程,董磊的数据分析等等,每个人都带着深刻的工作和思想,相互之间思想的碰撞,头脑风暴刷新着我的知识。白天的集中学习,晚上的自由讨论充实着我的每一天。明年的研读营我希望能继续参加。

1

复杂网络与全息原理

量子引力的全息理论是近二十年才兴起的方向。它将时空内部(bulk)的量子引力理论与时空边界(boundary)上的非引力的量子场论对偶起来。这个理论吸引人的地方在于,我们可以认为引力现象并不是基本的,而是可以从非引力的场论自由度演生(emerge)出来。具体的说,场论各个自由度之间的纠缠与关联实际上代表了更高维度的时空几何。这个美妙的想法被神经网络优雅的描述了。隐藏层连接着显层,表征着显层单元之间的关联与纠缠。而更高维度的几何就自然地出现在演生的隐藏层中。

在这些天与大家的交流中,我看到复杂网络在各个领域中都有应用,而上面的想法也启示我,在引力理论中,共形场论(Conformal Field Theory)的复杂网络正是反德西特时空(Anti-de Sitter Space-time,双曲几何)。进一步的说,复杂系统(例如CFT)之所以复杂,是由于存在复杂的内部关联(隐藏的内部关联),这些关联由隐层描述,而形成加入了隐层的复杂网络,这个复杂网络会有不同的几何(例如双曲几何)以及简洁的规律(例如Einstein场方程)。

特别是尤亦庄师兄的使用DBM通过数据学习得到复杂网络连边的coupling constant,从而boundary state通过机器学习得到bulk几何的相关思想更是深深的冲击着我。我们宇宙也许就是这样由边界系统的自主机器学习过程而演生出来的复杂网络结构。

2

临界系统

傅渥成的关于自组织临界(self-organized criticality)系统的讨论再一次刷新了我的三观。许多系统都可以用自组织临界理论进行描述。

自然界中很多重要的系统都不是处在热平衡态,比如生命本身。热平衡意味着没有变化,意味着熵极大,极度混乱的系统也就意味着没有生命。而有生命意味着有序,即负熵。生命就是由生命体内部相互作用导致的自组织规律系统。不仅如此,生物系统还在临界点附近。临界点意味着特殊敏感,小的局部破坏可能导致整体的坍塌。傅渥成用著名的沙堆模型(sandpile model)进行说明:落下的沙子由于沙子内部的相互作用会形成沙堆。这是自组织的过程。但是当沙堆增高到一定程度之后,落下一粒沙会导致整个沙堆的坍塌。这是临界状态,对小的扰动很敏感。这是因为临界的系统具有长程关联,相距遥远的部分之间有强关联,也就导致了一个部分的破坏引起大部分的破坏。不仅如此,长程关联还意味着标度不变。这是由于体系内部的关联长度发散,没有特征长度(characteristic length)也就说明系统的各个物理量与尺度无关,即标度不变。甚至自组织临界系统的几何一定是双曲(hyperbolic)几何。因为双曲几何是唯一具有标度不变性的几何。

进一步,自组织临界系统的各个量显示出幂律关系。不仅如此,就连成功学都具有幂律。西北大学的殷裔安分析NIH三十多年来的基金申请记录,发现最终成功申请的科研工作者成功之前失败的申请中连续两次的申请时间间隔满足幂律衰减。幂律,或者说临界状态是各个自组织系统的关键。它将不同学科神奇的联系了起来。

3

机器学习与程序生长

机器学习是近两年非常火的课题,特别是是Google的AlphaGo打败了人类的围棋冠军之后。机器学习也是这次研读营的核心课题之一。我们围绕着机器学习进行了各方面的讨论:

尤亦庄师兄介绍了tensorflow graph,罗秀哲介绍了pytorch以及机器学习和量子多体问题的关联, 程嵩介绍了Restricted Boltzmann machine和tensor network之间的关系。彩云天气的CEO 袁行远展示了机器学习在天气预测,语音翻译和智能作曲等方面强大的功能。以及肖达介绍了序列学习模型RNN/LSTM。肖达的“将世界的普适规律“硬编码”到网络结构中”,苑明理的程序代码的生长机制都将世界以及生物与机器学习深刻的联系了起来。他们让我相信,世界的本质规律也许就是机器自我学习的过程,我们的宇宙是一台量子计算机,包括生命本身。这些都冲击着我的世界观。我们正朝着这个方向不断的探索。

4

大数据与计算社会学

这次的研读营,社会学家们也带给我太多惊讶与惊喜。Kevin的线上社会学实验,将社会学实验融合进小游戏中,使得线上的网友们都可以参与进来,且由于破除了地域和时间的限制,使得实验规模宏大,样本数量和数据量都非常多。还有上面提到的殷裔安对成功和失败的分析,平常无法分辨的通向成功的失败与通向失败的失败在这里都能从数据上体现出来,甚至满足幂律分布。董磊运用卫星数据进行可视化分析人口的流动,产业的变化,地区经济贫困与富裕的分析等等。这些都完美的将科学、技术、艺术和人文关怀紧密的联系了起来。使我相信科技是能改变社会的。

吴令飞、马磊与尤亦庄师兄的Ising model和社会计算与图灵机的讨论再一次揭示了复杂网络与社会学的深刻关系。甚至可以用Ising model用来模拟议会投票机制。复杂网络再一次将物理学、社会学、计算机科学紧密的联系了起来。

这次的研读营每天都给我带来不同的头脑风暴,除开白天的集中学习与讨论,晚上的自由讨论也随处可见。浓厚的学习氛围感染着我激励着我。这短短的几日给我带来的冲击与震撼是前所未有的,吴令飞鼓励我们多关注有趣的问题,不同的专业互相交流探讨。这些拓宽了我的眼界。希望集智的研读营越办越好。

量子纠缠,复杂网络与机器学习在集智融合 | 黄金龙

黄金龙 南方科技大学大四本科生

研究方向:量子信息与相对论和凝聚态的交叉。大三时分析过纠缠在黑洞附近如何变化,也做过波色抽样(quantum supremacy的一种方案)的理论分析及经典模拟。对deep Boltzmann machine以及机器学习的理论模型比较感兴趣。

2017年5月份的时候@甘文聪来我们南方科技大学访问两个月,探讨引力与量子信息的交叉,我们在知乎上看到集智俱乐部的招募,就一起提交了材料,去年参加研读营有凝聚态,统计物理,机器学习和社会科学的大牛,今年也只计划新招两个名额,只是本科生的我提交材料时心里没什么底,心想就碰碰运气,没想到却和@甘文聪一起收到了集智俱乐部的邀请,感到很惊喜。

我之前只会一些量子信息和量子计算的皮毛,在甘同学的访问期间学了一点广义相对论和量子场论,考虑纠缠是怎么在黑洞视界附近受到影响。另外我们课题组有师兄研究过把机器学习应用到Bell不等式,所以也想多了解一下机器学习和量子信息的交叉。在参加研读营之前听过尤亦庄老师的讲的报告,用random tensor network来学习空间的geometry,非常佩服。这次来研读营有两个期望,一是希望多了解一些机器学习背后的数学结构,二是和尤老师多讨论一下凝聚态和量子信息的结合。

1

纠缠与几何

正式开始的前一天晚上我是最晚一个到的,错过了大家的各自介绍,有点可惜。不过一来就感受到讨论的氛围非常热烈,尤老师跟我们讨论了一下他的思路,根据boundary entanglement的feature来学习出bulk的geometry。去年尤老师考虑固定张量网络的结构,使用随机张量网络,只训练耦合常数J,今年希望能够通过学习自动找到合适的网络结构。

其实基本思想很简单,quantum many-body state可以用random tensor network的boundary tensor来表示,每一个many-body state出现的概率由这个系统的hamiltonian决定,也就是boundary的pinning field(外磁场)。神奇的是由这个hamiltonian决定的一个many-body state的free energy算出来正好近似等于这个state的entanglement entropy(2nd Renyi entropy)。当我们根据这个概率分布来生成大量的boundary states(不同的spin configuration)后,我们就有了unlabeled data,用这些unlabeled data我们可以做unsupervised learning,最小化KL Divergence,使得模型的概率分布尽可能接近data的概率分布。如果我们使用Boltzmann machine,boundary states看做visible layer,bulk states看做invisible layer,training过后我们就得到层与层之间的weight,也就是这个网络的几何性质。如果不使用Boltzmann machine,考虑全连接图或者planar graph,再加上update的规则,我们就能在不固定网络结构前提下训练出它偏好的构型。

对于planar graph,可以使用三角剖分的三种基本规则来update:(1)找到所有的度数为3的顶点,随机去掉一个;(2)随机找一个三角形,在内部添加一个点,并与三个顶点相连;(3)随机切换一个四边形的对角线。可以证明,这三种update的规则能够覆盖所有可能的planar graph。问题的核心在于如何在given hamiltonian的条件下计算free energy(2nd Renyi Entropy)。

进一步,如果加上物质场,也就是beyond planar graph,以及给boundary tensor加上各种symmetry,比如U1,SU2 symmetry,我们甚至能得到各种基本粒子,像电磁场中的光子,或者是各种费米子,这样我们就把物理学中的各种基本粒子的产生理解为自然界在unsupervised learning不同的纠缠结构,和文小刚教(da)授(lao)的思想遥相呼应。没想到纠缠,几何和学习能够以这样一种奇妙又紧密的方式结合起来,在传统物理学的训练中从来没有过这样思想的冲击和颠覆。

2

计算社会科学

几天的会议讨论后,在物理以外的领域有三点比较大的收获,一是殷裔安同学通过美国NIH申请基金的近30年的记录,来分析哪些科学家会在重复的失败后成功地申请到基金,结果发现对于成功者而言,在申请成功之前的大概十次失败的申请中,他们申请的时间间隔是按power law减少的,而对于失败者而言,他们的时间间隔的分布大概是均匀的。社会科学的研究原来是基于大量数据的分析或者通过控制变量的实验来分析社会行为背后的机制。二是computational social science和virtual lab这两个概念,传统的社会科学做实验没有计算机,只能通过调查问卷等方式来分析研究,有很多实际受限,消耗大量的人力物力也不能做太大,现在可以借助网络在线上建立虚拟社会科学实验室,在三个维度scale,complexity和endure都能极大地扩张,在传统的社会科学的基础上进行了质的飞跃。三是补充了一些人工智能和机器学习的基础知识,比如RNN中的Recurrent是怎么实现的,LSTM是怎么在RNN的基础上加入三个gate实现长短时记忆,把神经网络的每一层按一定比例drop out一些神经元来训练多个随机森林,概率图模型是怎么和张量网络,神经网络建立一一对应关系,最近新出来的三种Gan到底有什么区别。

通过将近一周的热烈讨论,不仅把我自己的研究领域扩展到凝聚态,还学习到了很多其他领域的知识,这些知识在平时学校里普通的学习过程中几乎没有办法接触到,特别感谢集智俱乐部创建起这样一个组织,以及基金会资助举办这样学术交流的活动,把不同领域感兴趣的学者聚集在一起,在不同维度思想的碰撞中产生新的火花。

推荐阅读

集智AI&Policy研讨会第二日:当复杂系统遇见深度学习

清华教授薛澜:中国科学家国际地位上升|集智AI&Policy研讨会

记2016年凯风集智研读营:对机器学习、张量网络和物理的一些看法|程嵩

记2016年凯风集智研读营:朝闻道,夕如何?|小木球

记2016年凯风集智研读营:网络、几何与物理:层级、长程关联与局域化|章彦博

集智QQ群|292641157

商务合作|

投稿转载|

◆ ◆ ◆

搜索公众号:集智俱乐部

加入“没有围墙的研究所”

0

推荐

京公网安备 11010502034662号

京公网安备 11010502034662号